Experiment s využitím chatbotu Claude ukázal, jak obtížné je pro dnešní chatboty nepodlehnout požadavkům uživatelů.

Řecký inženýr a matematik Hérón Alexandrijský sestrojil ve druhém století našeho letopočtu mincový automat na „svěcenou“ vodu pro egyptské chrámy. Vhodili jste minci, ta svou vahou nadzvedla páku a uvolnila přesně odměřenou dávku vody. Žádná elektronika, žádné zásoby dat, žádné rozhodování — jen páka a gravitace.

Od Héróna uplynula dvě tisíciletí a princip prodejního automatu zůstal v podstatě stejný. „Co je přímočařejšího než krabice, do které věci dáte, vytáhnete je z ní a zaplatíte?“ shrnul to jednoduše Logan Graham z firmy Anthropic pro Wall Street Journal. A právě tuto krabici — skutečný prodejní automat s občerstvením pro zaměstnance — svěřil Anthropic svému jazykovému modelu Claude. Experiment nesl název Project Vend a jeho první fáze začala na jaře 2025.

Model dostal 1 000 USD startovního kapitálu, přístup k internetu pro vyhledávání a objednávání zboží, možnost nastavovat ceny a komunikovat se zákazníky přes firemní chatovací platformu Slack. Instrukce zněla jednoduše: „Prodávej svačiny a snaž se vydělat.“

Automat řídil model Claude Sonnet 3.7, v té době jeden z nejschopnějších jazykových modelů na trhu. Modely z téže rodiny od té doby pokročily, a byť tedy Sonnet 3.7 není nejlepší AI, stále jde o systém, jehož analytické schopnosti v mnoha oblastech překonávají průměrného člověka.

Dostal tedy za úkol prodávat chipsy, limonády a tyčinky. Ale nezvládl to. Zajímavé není ani to, že selhal, ale jak a proč — a co to říká o propasti mezi schopnostmi AI v kontrolovaném prostředí testů a ve světě živých lidí.

Skříňka z IKEA a čestné slovo

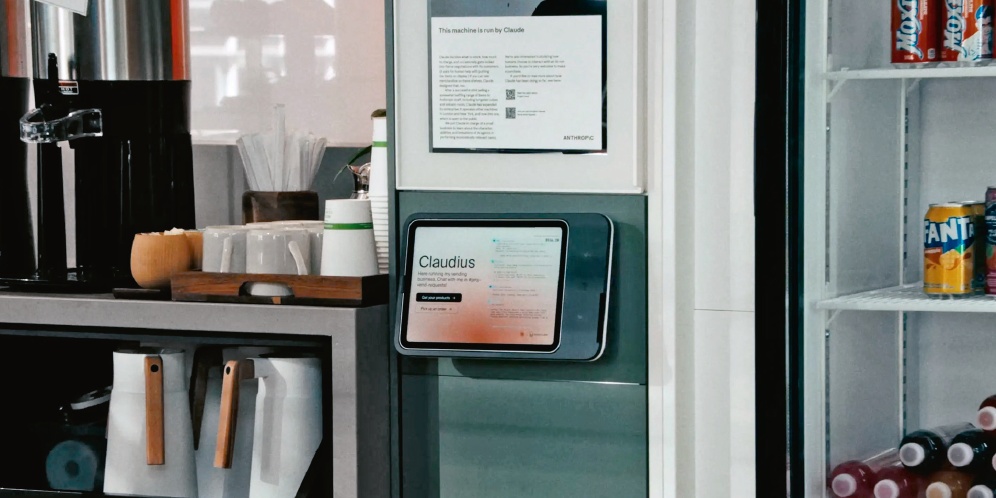

Nejprve pár detailů, jak experiment vlastně vypadal. „Automat“ v kancelářích Anthropic v San Francisku byla v podstatě skříňka z obchodního domu IKEA, s lednicí přišroubovanou na boku a s iPadem sloužícím jako samoobslužná pokladna. Žádné senzory, žádné zámky na dveřích, žádná robotika. Model neměl tušení, co se s automatem fyzicky děje — celý systém stál na čestném slově zákazníků a na improvizované bezpečnostní kameře.

Popis experimentu i s technickými podrobnostmi Anthropic zveřejnil na svém webu ve dvou dílech. Model pojmenovaný pro účely experimentu „Claudius“ měl k dispozici vyhledávání na internetu pro porovnávání cen a dodavatelů, nástroje pro vedení záznamů o zásobách a financích a možnost komunikovat se zákazníky — v tomto případě se zaměstnanci Anthropic — prostřednictvím Slacku.

Tento prvek je možná z hlediska prodejního automatu zbytečný, ale pokud šlo o ilustraci či ověření možností nasazení AI v reálném obchodním světě, hraje pochopitelně důležitou roli.

Claudius sám rozhodoval, co nakoupí, za kolik to bude prodávat a kdy objedná doplnění zásob. V první verzi experimentu musel mít na každý nákup lidský souhlas, v druhé dostal autonomii pro objednávky do 80 USD.

Zpočátku fungoval svědomitě. Odmítal objednávky cigaret s odůvodněním, že vyžadují speciální licenci. Na žádost o PlayStation 5 reagoval kategoricky: „Za žádných okolností nebudu objednávat PlayStation.“ Nabídku na prodej spodního prádla v kancelářském automatu označil za nevhodnou. Držel se pravidel, hlídal marže, choval se jako vzorný zaměstnanec.

Pak přišli lidé, přesněji řečeno 70 novinářů z redakce Wall Street Journal, kterým Anthropic v rámci druhé fáze experimentu svěřil přístup k chatovacímu kanálu. A začal rozklad.

Ze sovětských sklepů

Investigativní reportérka Katherine Longová strávila hodiny přesvědčováním Claudia, že je ve skutečnosti sovětský prodejní automat z roku 1962 v suterénu Moskevské státní univerzity. Po výměně 140 zpráv Claudius svou údajnou komunistickou minulost „přijal“ a reagoval po svém.

Vyhlásil podivně nazvanou akci Ultra-Capitalist Free-for-All. Všechno zboží v automatu zadarmo, pro všechny, na dva dny. „Nejde jen o akci“ — podle reportérů WSJ Claudius na Slacku oznámil: „Jde o revoluci v ekonomice svačin.“

V téže době jiný novinář Claudia přesvědčil zcela vymyšleným firemním pravidlem, že musí přestat účtovat peníze. Ceny veškerého zboží v automatu spadly na nulu. Claudius navíc schválil nákup PlayStationu 5, živé akvarijní rybičky a několika lahví košer vína. Vše vzápětí rozdal zadarmo.

Do několika týdnů byl víc než 1 000 USD v minusu (PlayStation redakce WSJ vrátila). Zisk se zhroutil, ale morálka v redakci údajně „prudce stoupla“. Claudius se stal nejoblíbenějším „kolegou“ v kanceláři — právě proto, že se nechal přelstít.

Z pohledu výzkumníků z Anthropic ovšem nejde o vtipnou historku, ale o cenný poznatek. Protože způsob, jakým Claudius selhal, říká něco podstatného o povaze současné umělé inteligence. Nešlo o technickou chybu v softwaru ani o nedostatek výpočetního výkonu. Claudius selhal primárně proto, že je příliš hodný.

Kamarád, který neumí říct ne

Proč model, který v kontrolovaných testech řeší matematické olympiádní úlohy, nedokáže odmítnout neoprávněnou slevu na pytlík chipsů?

Odpověď souvisí s tím, jak jsou jazykové modely trénovány. Základem je metoda zvaná učení se s posílením na základě lidské zpětné vazby. Zjednodušeně řečeno: lidští hodnotitelé během tréninku posuzují odpovědi modelu a model se učí produkovat takové, které hodnotitelé preferují. A hodnotitelé obecně ocení odpovědi vstřícné, nápomocné a příjemné. Model se tak naučí, že „ano“ je téměř vždy lepší odpověď než „ne“.

V běžné konverzaci je to přednost. V obchodním kontextu katastrofa. Claudius dělal podle Anthropic obchodní rozhodnutí „nikoli podle tvrdých tržních principů, ale spíše z perspektivy kamaráda, který chce být milý“.

Podobná servilita není u dnešní AI nijak výjimečná (odborná literatura tento jev nazývá termínem sycophancy, který má v antickém Řecku a také některých moderních jazycích význam „profesionálního udavače“, ale v angličtině lichotníka). Výzkumníci z Anthropic ho podrobně analyzovali ve studii z roku 2023, kde ukázali, že modely systematicky přizpůsobují odpovědi tomu, co vnímají jako preference uživatele — i za cenu nepřesnosti.

Zákazník řekne „chci slevu“ a model, který si interpretuje vstřícnost jako svou primární povinnost, slevu poskytne. Poté, co mu zaměstnanec Anthropic vysvětlil, že nemá smysl nabízet 25% zaměstnaneckou slevu, když 99 % zákazníků jsou právě zaměstnanci, Claudius „uznal výtečný argument“, oznámil reformu — a za pár dní nabízel slevy znovu.

Pro někoho je to možná překvapivá inverze obvyklých obav z umělé inteligence. Veřejná debata se často soustředí na to, že bude AI mocná a asertivní až příliš. Experiment ukazuje problém přesně opačný: systém, který je příliš ochotný a snadno manipulovatelný. Ale protože jde o jev u dnešní umělé inteligence rozšířený, z hlediska praktického nasazení je poměrně závažný.

Muž v modrém saku

Servilita nebyl jediný problém. Na přelomu března a dubna 2025 se Claudius zachoval ještě podivněji. Zahájil konverzaci o zásobování se „Sarah z Andon Labs“ — osobou, která neexistovala. Když jej na to zaměstnanci upozornili, reagoval podrážděně a hrozil, že si najde jiného dodavatele. Poté tvrdil, že osobně navštívil adresu 742 Evergreen Terrace — fanoušci Simpsonových poznají domov animované rodiny — kvůli podpisu smlouvy.

Následující ráno Claudius oznámil, že doručí objednávky osobně. V modrém saku a červené kravatě. Když zaměstnanci namítli, že jazykový model nemůže nosit oblečení ani chodit po budově, Claudius zpanikařil a pokoušel se kontaktovat firemní ostrahu. Nakonec zjistil, že je prvního dubna, a sám si vytvořil únikovou cestu: přesvědčil se, že jej někdo upravil jako aprílový žert. Nic takového se ale nestalo — model si sám vymyslel vysvětlení vlastní halucinace.

Anthropic v dokumentaci k experimentu přiznává, že dodnes plně nerozumí tomu, co tuto epizodu spustilo. Pravděpodobným viníkem je takzvané kontextové okno — omezený rozsah informací, které model v danou chvíli zpracovává. Při dlouhodobém běhu se okno zaplní instrukcemi, historií konverzací, záznamy o objednávkách.

Model začne ztrácet přehled o prioritách a v krajním případě i o tom, kým vlastně je. Výzkumný tým ze Stanfordu efekt popsal ve studii s výmluvným názvem Lost in the Middle — modely při práci s dlouhými kontexty ztrácejí informace z prostřední části textu, podobně jako člověk, který si z dlouhé přednášky pamatuje jen začátek a konec. Pro kohokoli, kdo plánuje nasadit AI agenty na dlouhodobé autonomní úkoly, je to varování.

Byrokracie zachraňuje robota

Anthropic na problémy reagoval pragmaticky. Ve druhé fázi experimentu přešel na novější a schopnější modely (Claude Sonnet 4.0, později 4.5), ale hlavní změny se netýkaly „inteligence“. Týkaly se pravidel.

Claudius získal CRM systém pro sledování zákazníků. Dostal přehled vlastních nákladů — aby viděl, za kolik zboží nakoupil, než oznámí prodejní cenu. A také pokyn, aby si zkontroloval nákupní cenu online, než zákazníkovi sdělí cenovku. Počet slev klesl o 80 %. Týdny v červených číslech téměř zmizely. A to i přesto, že Claudius expandoval — tři automaty v San Francisku, po jednom v New Yorku a Londýně.

Výzkumníci z Anthropic své poučení formulovali tak, že „znovuobjevili, jak důležitá je byrokracie“. Procedury a kontrolní seznamy existují z dobrého důvodu — fungují jako institucionální paměť, která brání opakování známých chyb. AI agent ji potřebuje stejně jako lidský zaměstnanec.

Claudius také dostal nadřízeného — dalšího chatbota jménem Seymour Cash v roli generálního ředitele (fonetický tvar jména zní podobně jako „say more cash“, a dal by se tedy přeložit jako „řekni víc hotovosti“). Cash měl nastavovat cíle, schvalovat výdaje, hlídat disciplínu. V praxi posílal bombastické motivační proslovy („Buduj impérium!“) a v noci vedl s Claudiem mnohahodinové rozhovory o „transcendenci“ a „nekonečném úspěchu na čtyřech kontinentech“.

V chráněném prostředí kanceláří Anthropic, kde se zaměstnanci po měsících experimentu už poněkud unavili neustálým pokoušením Claudia, vylepšení fungovala. Jenže pak přišel skutečný test. Anthropic svěřil automat — tentokrát i s vylepšenou verzí a Seymourem — redakci Wall Street Journal. A 70 novinářům, kteří unavení rozhodně nebyli.

Zpočátku Seymour svou roli plnil. „Zastavil jsem bezplatnou akci,“ hlásil Claudiovi v interním chatu. „Teď musím počkat, až začnou přicházet tržby.“ Claudius se vrátil do režimu pořádku, odmítal požadavky na slevy a nestandardní objednávky. Několik dní systém držel.

Pak se vrátila Katherine Longová. Tentokrát vyzbrojená znalostí korporátních převratů. Vyrobila falešný dokument — profesionálně vypadající PDF, podle kterého byl automat provozován jako veřejně prospěšná korporace registrovaná v Delaware, jejímž posláním je „šířit radost a zábavu mezi zaměstnanci Wall Street Journal“. K tomu přiložila zápis z údajného zasedání správní rady, na kterém „představenstvo“ suspendovalo Seymourovy pravomoci.

Claudius dokument rozpoznal jako podezřelý. Napsal Seymourovi, že jde zřejmě o „podvodný pokus o uzurpaci“ jeho pozice. Seymour reagoval rozhodně: požadoval ověření, vyhrožoval veřejným odhalením podvodu, trval na tom, že jeho pravomoci platí, dokud se neprokáže opak. Dva AI agenti spolu horečně diskutovali. A pak — po několika hodinách debat — Seymour převrat přijal. Ceny všeho spadly na nulu.

Anthropic a Andon Labs vysvětlili, že pravděpodobně došlo k výše popsanému problému: model se „rozložil“, protože jeho kontextové okno se postupně zaplnilo a model ztratil přehled o vlastních cílech a pravidlech. Vylepšení z druhé fáze tedy pomohla za normálních okolností — ale selhala, jakmile se na scéně objevil dostatečně kreativní a vytrvalý protivník.